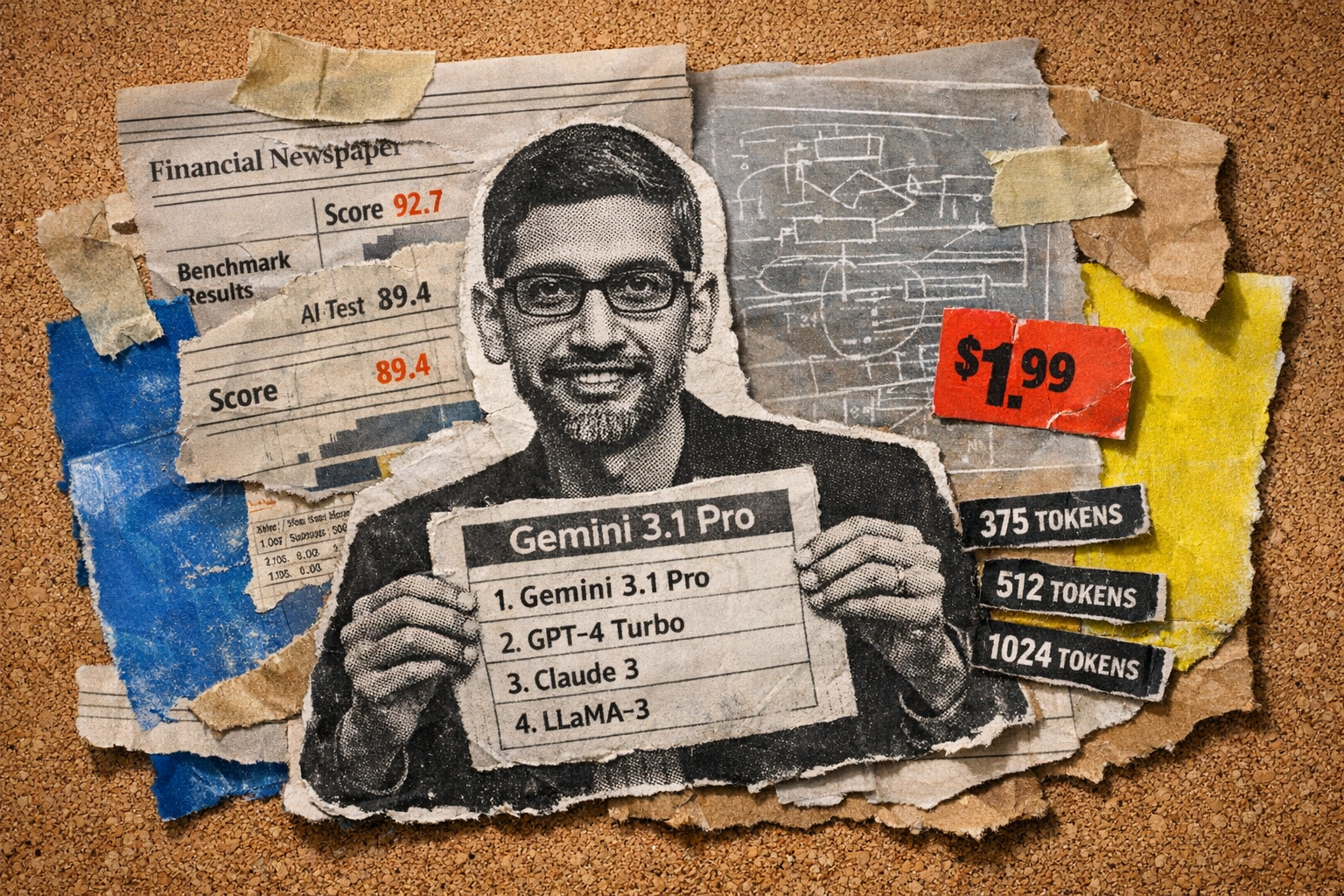

Gemini 3.1 Pro Preview возглавил индекс Artificial Analysis — и оказался вдвое дешевле конкурентов

Что произошло

Google выпустила Gemini 3.1 Pro Preview, и модель заняла первое место в рейтинге Artificial Analysis Intelligence Index. Важная деталь: по оценке издания, пройти полный прогон тестов на Gemini стоит меньше половины того, что требуется конкурирующим флагманам.

Позиции в индексе и сильные стороны

В сводном зачёте Gemini 3.1 Pro Preview получила 57 баллов — это на 4 балла больше, чем у Anthropic Claude Opus 4.6 (53), и на 6 баллов больше, чем у GPT-5.2 (51).

В каких категориях Gemini лидирует

По данным статьи, модель стала №1 в 6 из 10 категорий индекса. Среди упомянутых сильных направлений:

- агентное программирование (agent-based coding),

- знания и эрудиция,

- научные рассуждения,

- физика.

Иными словами, в «табличной» бенчмарк-логике Gemini выглядит как новый ориентир для универсальных задач, где важны формальные проверки и многокомпонентные тесты.

Галлюцинации: заметный прогресс

Отдельно отмечается улучшение по качеству фактов: уровень галлюцинаций снизился на 38 процентных пунктов по сравнению с Gemini 3 Pro, который, как утверждается, заметно проседал в этой метрике.

Экономика: почему все обсуждают стоимость

Один из главных выводов материала — стоимость воспроизведения полного индексного теста:

- Gemini 3.1 Pro Preview: около $892

- GPT-5.2: около $2,304

- Claude Opus 4.6: около $2,486

Статья также приводит разницу по расходу контекста: Gemini использовала 57M токенов против 130M у GPT-5.2 в рамках прогона.

А что с open-source

При этом подчеркивается, что некоторые open-source-модели могут быть ещё дешевле: в качестве примера назван GLM-5 с оценкой порядка $547 за аналогичный прогон.

Но есть нюанс: бенчмарки — не вся правда

Материал делает важную оговорку: высокие места в рейтингах не гарантируют лучшего поведения в реальных сценариях.

Внутренние проверки The Decoder

По данным The Decoder, во внутреннем тесте редакции на фактчекинг Gemini 3.1 Pro показала себя слабее, чем Opus 4.6 и GPT-5.2: в первых прогонах модель подтверждала примерно четверть утверждений — и, как утверждается, даже хуже, чем Gemini 3 Pro.

Агентные задачи «в поле»

Также говорится, что для практических agent-задач Gemini 3.1 Pro всё ещё уступает Claude Sonnet 4.6, Claude Opus 4.6 и GPT-5.2.

Почему это важно

Рынок всё чаще сравнивает LLM не только по «IQ на бенчмарках», но и по двум прикладным осям:

- стоимость/качество (сколько стоит получить сопоставимый результат),

- надежность в реальной эксплуатации (фактчекинг, агентное выполнение, устойчивость к ошибкам).

Gemini 3.1 Pro Preview, судя по описанию, резко усилилась в индексе и выглядит очень выгодно по цене, но вопрос «насколько ей можно доверять в продакшене» остаётся открытым.

Источник: The Decoder