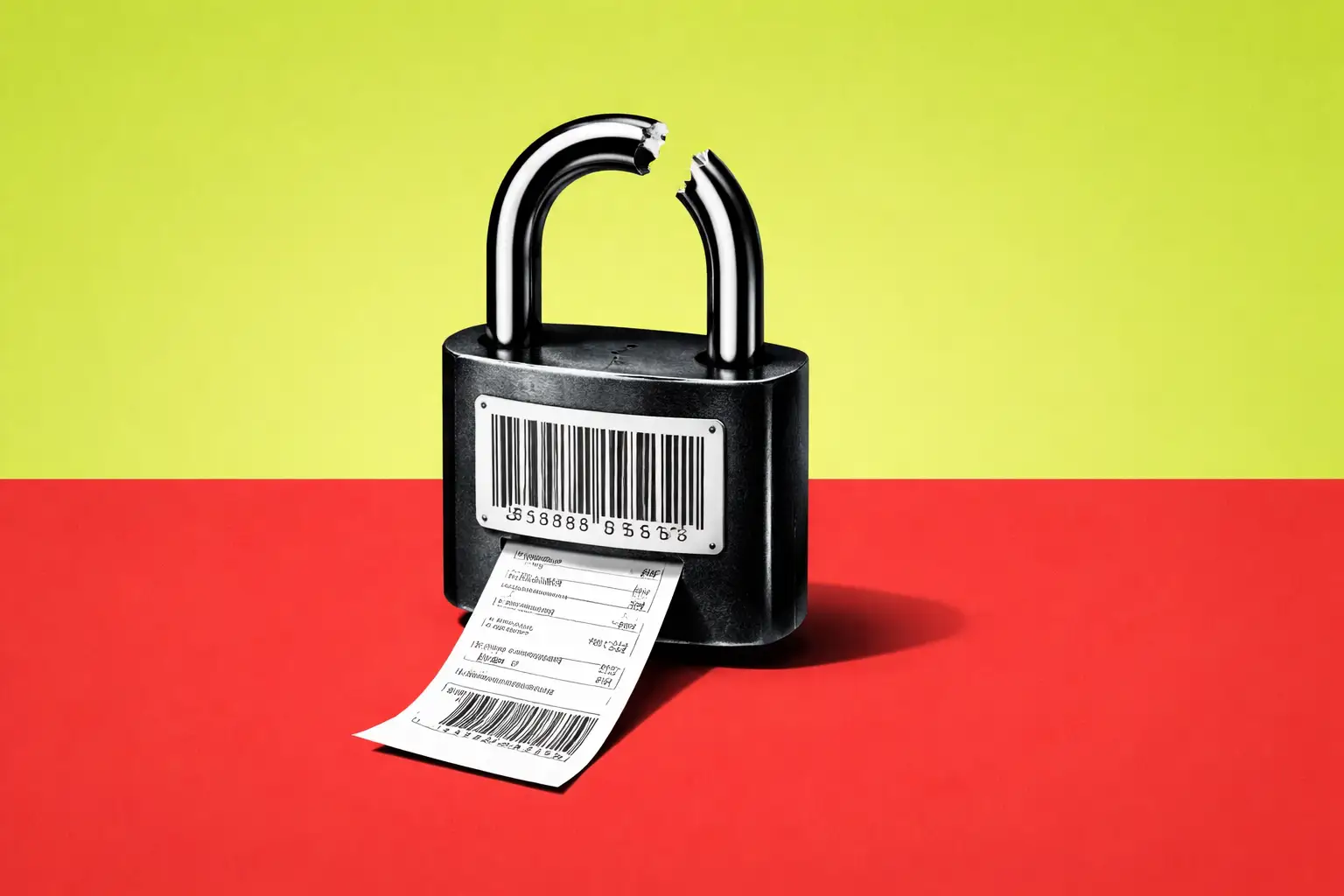

Вирусные AI-карикатуры в соцсетях подсветили риски Shadow AI для бизнеса

Что происходит: «карикатура про меня и мою работу» стала маркером рисков

В Instagram и LinkedIn разошёлся тренд: пользователи просят ChatGPT (и другие LLM) сделать карикатуру «про меня и мою профессию», а затем публикуют результат. На первый взгляд это безобидный вирусный флешмоб, но для компаний он может обернуться неприятным побочным эффектом: такие посты часто становятся сигналом, что сотрудник применяет публичный ИИ в рабочем контексте — причём возможно без согласования с ИБ и без технических ограничений.

Почему это связано с Shadow AI

Под «shadow AI» понимают ситуацию, когда сотрудники используют внешние AI-сервисы в обход корпоративной политики и контролируемых инструментов. В этом сценарии риски возникают не из-за картинки как таковой, а из-за того, что:

- сотрудник мог «скормить» модели рабочую информацию (контекст роли, клиентов, внутренних процессов);

- сама публикация карикатуры подтверждает, что человек прибегает к LLM для рабочих задач;

- по изображению и подписи нередко угадываются должность, отрасль, стек инструментов, доступы и уровень влияния.

Ключевой фон: утечки чувствительных данных

Материал связывает тренд с тем, что в корпоративной безопасности давно выделяется риск раскрытия чувствительной информации при работе с LLM (в том числе в логике OWASP LLM Top 10). Проблема шире, чем «лишнее в соцсетях»: если данные попали в промпт или историю чатов, дальше появляется множество путей их компрометации — от ошибок доступа до успешных атак на учетные записи.

Как тренд расширяет поверхность атаки

Массовые публикации превращаются в поисковую базу потенциальных целей:

- карикатуры часто «упаковывают» роль человека (финансы, продажи, HR, инженеры, безопасность);

- пост становится подтверждением, что человек пользуется конкретным AI-сервисом;

- злоумышленникам проще составлять списки приоритетных целей и делать более правдоподобные сценарии фишинга и социальной инженерии.

Два основных вектора угроз

1) Захват аккаунта LLM (LLM account takeover)

Если атакующий сопоставит публичный профиль с рабочим email и ролью, ему проще запустить точечный фишинг. При успешном взломе LLM-аккаунта ценность может быть высокой: в истории диалогов иногда оказываются фрагменты клиентских данных, внутренние переписки, финпоказатели, код или планы проектов.

2) Манипуляции поведением модели (prompt injection и смежные приёмы)

Отдельно подчёркивается класс рисков, связанных с попытками обхода ограничений модели и «перенастройки» поведения через подсказки и инструкции. Сам тренд не является уязвимостью, но он демонстрирует вовлечённость сотрудников в неконтролируемые AI-практики, а значит повышает вероятность, что в компании уже есть слабые места в процессах.

Что рекомендуют компаниям

Материал сводит профилактику к управлению и базовой «гигиене»:

- закрепить правила AI-использования и governance, объяснить, что считается допустимым;

- предоставить корпоративно управляемую альтернативу публичным чат-ботам;

- подключить DLP и классификацию данных, ограничить ввод чувствительной информации;

- усилить IAM и MFA, снизить риск компрометации аккаунтов;

- мониторить и контролировать AI-трафик, где это уместно;

- добавить AI-сценарии в обучение, tabletop-упражнения и планы реагирования;

- отслеживать признаки утечек и компрометации учетных данных.

Важная мысль

Главный вывод: вирусные «рабочие» карикатуры — не первопричина проблем, а индикатор, что shadow AI уже рядом. И если организация не предлагает безопасный маршрут использования ИИ, сотрудники найдут «удобный» — но не обязательно безопасный.

Источник: TechRepublic